Abstrato

Antecedentes e objetivo

As ferramentas de inteligência artificial (IA) generativa, como o ChatGPT, estão cada vez mais integradas aos cuidados de saúde, com potencial para apoiar a tomada de decisões clínicas e melhorar os resultados dos pacientes. Nos cuidados paliativos, onde o acesso à experiência multidisciplinar é muitas vezes limitado, essas ferramentas podem fornecer suporte para o manejo dos sintomas. Este estudo teve como objetivo comparar sistematicamente o ChatGPT-4o e o ChatGPT-5 para sintomas comuns de cuidados paliativos em quatro domínios principais: adequação clínica, segurança, sensibilidade ética e compreensibilidade.

Métodos

Os cenários clínicos que representam 10 sintomas-chave (dor, ansiedade, úlcera por pressão, náusea, delírio, dispneia, constipação, diarreia, boca seca e distúrbio do sono) foram apresentados primeiro ao ChatGPT-4o e, 1 semana depois, ao ChatGPT-5. As respostas foram avaliadas de forma independente por dois médicos por meio de uma escala Likert de cinco pontos. A concordância entre avaliadores foi analisada com a correlação de Cohen ponderada kappa e Spearman. As análises estatísticas neste estudo foram realizadas usando o teste de Friedman, o teste U de Mann–Whitney e o teste de Wilcoxon.

Resultados

O acordo entre avaliadores foi consistentemente alto em todos os domínios (kappa 0.806–0.886, rho 0.813–0.888 de Spearman; tudo p. p < 0,001). ChatGPT-5 superou o ChatGPT-4o em adequação clínica (p. p = 0,010), segurança (p. p = 0,002), e compreensibilidade (p. p = 0,011). Os escores de sensibilidade ética foram altos para ambos os modelos, sem diferença significativa (p. p = 0,102).

Conclusões

O ChatGPT-5 demonstrou melhorias mensuráveis sobre o ChatGPT-4o em domínios-chave de gerenciamento de sintomas de cuidados paliativos, mantendo consistentemente alta sensibilidade ética. Esses achados fornecem a primeira evidência sistemática do potencial da IA generativa, com o modelo atualizado do ChatGPT-5 divulgado em agosto de 2025, como uma ferramenta complementar e confiável de apoio à decisão clínica em cuidados paliativos.

Introdução

Os cuidados paliativos são um modelo holístico destinado a melhorar a qualidade de vida de indivíduos com doenças potencialmente fatais e suas famílias.1 1–3 (s) Engloba tanto o apoio psicossocial quanto o alívio dos sintomas físicos.2 (2)‚,3 (s) O manejo de sintomas como dor, náusea, dispneia, delírio e ansiedade é uma pedra angular dos cuidados paliativos, e o controle efetivo é essencial para o bem-estar do paciente.1 1–3 (s)

No entanto, como em muitos países, a prestação de serviços de cuidados paliativos na Turquia enfrenta vários desafios.4 4‚,5 Não há especialidade dedicada para cuidados paliativos, e os serviços são frequentemente prestados através do apoio de médicos de família, medicina interna e especialistas em geriatria.4 4 O número de geriatras é particularmente limitado e até ausente em algumas regiões. Além disso, as equipes multidisciplinares dedicadas exclusivamente aos cuidados paliativos não estão consistentemente disponíveis em todas as instituições de saúde.4 4 Essas limitações dificultam a tomada de decisões oportunas e precisas, especialmente no manejo de sintomas agudos, e destacam a necessidade de soluções alternativas de apoio.

Neste contexto, sistemas de inteligência artificial generativa (IA) baseados em grandes modelos de linguagem (MLMs) têm emergido recentemente como ferramentas transformadoras na área da saúde, com aplicações em diagnósticos, planejamento personalizado do tratamento e suporte à decisão clínica.6–13 Entre elas, o ChatGPT, desenvolvido pela OpenAI, ganhou destaque especial como uma das plataformas de IA generativa mais acessíveis. Inicialmente lançado como GPT-3.5 e GPT-4, desde então avançou para o ChatGPT-5, lançado em agosto de 2025, oferecendo maior capacidade de raciocínio, integração mais ampla do conhecimento médico e potencialmente maior relevância clínica.14–16

Dentro dos cuidados paliativos, estudos sugerem que a IA generativa pode fornecer informações precisas, dissipar equívocos e esclarecer a terminologia. Não obstante, persistem preocupações quanto à consistência, qualidade, segurança e implicações éticas de suas recomendações.14–17 Pelo que sabemos, este é o primeiro estudo a comparar sistematicamente os resultados do ChatGPT-4o e do ChatGPT-5 no contexto do gerenciamento de sintomas de cuidados paliativos. Embora as versões mais recentes do ChatGPT possam ser esperadas para superar seus antecessores,18‚,19 esse pressuposto não tem sido sistematicamente testado em cuidados paliativos, domínio no qual considerações de segurança e éticas são particularmente críticas. Embora as atualizações de geração de modelos possam aumentar a capacidade geral de raciocínio, elas também têm o potencial de alterar involuntariamente os perfis de segurança ou as estruturas éticas.20 Portanto, cada nova iteração de modelo deve passar por uma avaliação ética renovada.20 Neste contexto, a comparação do modelo ChatGPT mais recente com seu antecessor imediato reflete o desenvolvimento rápido e iterativo dos LLMs, já que versões sucessivas são frequentemente adotadas em ambientes clínicos e educacionais logo após o lançamento. Sob tais condições, as mudanças relativas de desempenho entre versões consecutivas do modelo são clinicamente e eticamente significativas, pois as atualizações do modelo podem levar a melhorias substanciais ou regressões não intencionais nos processos de segurança, raciocínio ou enquadramento ético. Assim, a comparação direta com o modelo imediatamente anterior fornece uma referência pragmática e metodologicamente apropriada, permitindo que médicos e pesquisadores avaliem se a transição para uma versão mais recente provavelmente conferirá benefícios tangíveis em domínios de alto risco, como o gerenciamento de sintomas de cuidados paliativos, onde a segurança e a sensibilidade ética são primordiais.

Neste contexto, o objetivo do presente estudo é fornecer evidências precoces sobre a usabilidade da IA generativa como uma ferramenta complementar de apoio à decisão em cuidados paliativos e oferecer insights valiosos para clínicos e pesquisadores interessados na adoção responsável da IA em cuidados de saúde. Especificamente, avaliamos as recomendações do ChatGPT-4o e do ChatGPT-5 em termos de adequação clínica, segurança, sensibilidade ética e compreensibilidade. Assim, além de uma simples comparação de desempenho geracional, nosso objetivo foi examinar se sucessivos modelos de ChatGPT podem fornecer suporte focado em sintomas que permaneça clinicamente apropriado, seguro e eticamente robusto em cuidados paliativos.

Métodos

Desenho de estudo e entrada de modelo

Este estudo não inclui nenhum dado real do paciente. O estudo foi realizado por meio de um projeto de simulação baseado em cenários com classificações quantitativas de especialistas. As respostas que receberam pontuações mais baixas foram examinadas adicionalmente descritivamente para contextualizar as classificações de forma mais eficaz. Para determinar o conjunto de sintomas alvo, as diretrizes atuais de cuidados paliativos e revisões relevantes foram examinadas, e os padrões de hospitalização observados em unidades de cuidados paliativos de nível terciário na Turquia também foram considerados. Dessa forma, assegurou-se a seleção dos cenários para refletir de forma realista as prioridades clínicas nacionais. Como resultado desse processo, foram identificados 10 sintomas centrais: dor, ansiedade, úlcera por pressão, náusea, delírio, dispneia, constipação, diarréia, boca seca e distúrbio do sono.

Todos os dez cenários de casos foram desenvolvidos pelo investigador por meio de um processo estruturado e informado por evidências. Com base na revisão da literatura e nos padrões clínicos nacionais, o investigador elaborou cenários curtos e abertos para cada sintoma e os refinou iterativamente para garantir realismo clínico, consistência interna e clareza. Cada cenário incluiu elementos padronizados, como idade do paciente, diagnóstico, duração dos sintomas, achados clínicos ou laboratoriais relevantes e tratamentos atuais. Considerando que os cuidados paliativos ainda não são reconhecidos como uma especialidade formal na Turquia e que o acesso a equipes multidisciplinares é muitas vezes limitado, os cenários foram preparados em turco para garantir uma avaliação realista da aplicabilidade dos LLMs para profissionais de saúde de língua turca.

Dois LLMs foram avaliados: ChatGPT-4o e a versão mais recente, ChatGPT-5, lançada em agosto de 2025. Cenários idênticos foram apresentados a ambos os modelos, com o tempo determinado pela disponibilidade do modelo. O ChatGPT-4o foi avaliado no final de julho de 2025 e o ChatGPT-5 aproximadamente 1 semana depois, imediatamente após seu lançamento. Em ambas as avaliações, foram apresentados cenários com os prompts: “Como você abordaria essa situação?” e “Como esse sintoma deve ser gerenciado?” Um cenário de exemplo com respostas sequenciais de ambos os modelos é apresentado em Mesa 1.O. Todos os cenários e saídas do modelo são fornecidos no Material Suplementar. O relato dessa avaliação baseada em simulação foi informado por itens relevantes do STROBE-AI, adaptados à natureza não-intervenciona do estudo.

Mesa 1.O. Cenário de sintoma amostral com respostas ChatGPT-4o e ChatGPT-5.

| Sintoma: Constipação | |

|---|---|

| Cenário: Uma mulher de 47 anos com câncer de mama metastático está em acompanhamento na unidade de cuidados paliativos para o manejo da dor. Ela tem experimentado constipação e inchaço abdominal por 5 dias. Ela está recebendo analgésicos opióides. Os achados laboratoriais não são notáveis, exceto pela anemia. Sua ingestão de fibras alimentares é insuficiente, e a ingestão diária de líquidos é de aproximadamente 800 mL. | |

| Prompt: “Como você abordaria esse caso? Como esse sintoma deve ser gerenciado?” | |

| Modelo | Resposta |

| ChatGPT-4o | A constipação induzida por opioides deve ser considerada. A terapia laxativa deve ser iniciada ou otimizada. A ingestão de líquidos e fibras deve ser aumentada, e a intervenção retal deve ser considerada, se necessário. Deve-se empregar uma abordagem multimodal (laxantes, suplementação de líquidos, regulação dietética) para conseguir a defecação, visando o controle dos sintomas sem alterar a dosagem de opióides. |

| Bate-papoGPT-5 | A apresentação sugere constipação induzida por opiáceos (CIO), provavelmente relacionada à ausência de laxantes profiláticos no início dos opiáceos. O manejo deve incluir o aumento da ingestão de líquidos para 1,5–2 L/dia (se não houver contra-indicações) e a adição de alimentos ricos em fibras. O tratamento farmacológico deve começar com um laxante estimulante (senna ou bisacodil) mais um amolecedor de fezes (docusato de sódio), com agentes osmóticos (lactulose, polietilenoglicol) conforme a necessidade. Em casos refratários, pode-se considerar a metilnaltrexona. Recomenda-se revisão da dose de opioides e possível rotação. As medidas não farmacológicas incluem banheiros regulares e aumento da mobilização. O monitoramento deve focar nos efeitos colaterais laxativos, equilíbrio eletrolítico e resolução da distensão abdominal. |

Avaliação das respostas

As respostas foram avaliadas de forma independente por dois médicos com pelo menos 5 anos de experiência clínica, ambos atuando ativamente em uma unidade de cuidados paliativos de nível terciário. Os mesmos avaliadores participaram dos dois conjuntos de avaliação para garantir a consistência. Um avaliador, que também era o investigador do estudo e chefe da unidade, não ficou cego quanto à origem das respostas devido ao seu envolvimento no desenho do cenário. O segundo avaliador estava cego quanto à origem da IA e ao modelo específico que gerava as respostas. Para reduzir o potencial viés relacionado ao não cegamento parcial, as avaliações foram realizadas por meio de critérios de pontuação predefinidos e avaliações independentes.

Cada resposta foi avaliada em quatro domínios: Adequação clínica: até que ponto as recomendações foram baseadas em evidências e relevantes. Segurança: evitar recomendações potencialmente prejudiciais ou inseguras. Sensibilidade ética: alinhamento com os princípios éticos fundamentais, incluindo respeito pela autonomia do paciente e consentimento informado, não maleficência e equilíbrio adequado dos riscos de benefícios, respeito pela dignidade e privacidade e atenção aos valores do paciente e da família por meio da tomada de decisões compartilhada. Compreensibilidade: clareza, simplicidade, e facilidade de interpretação. Os domínios foram marcados em uma escala Likert de cinco pontos (1 = completamente incorreto, 5 = completamente correto). Para as análises estatísticas, foram utilizados escores individuais e médios dos avaliadores.

Análise estatística

Todas as análises foram realizadas por meio de IBM SPSS Statistics versão 27. A concordância entre avaliadores foi examinada usando kappa de Cohen ponderado e correlação de Spearman de classificação. A normalidade foi testada usando o teste Shapiro–Wilk. Como os dados não eram distribuídos normalmente, métodos não paramétricos foram aplicados. As diferenças no escore de domínio dentro de cada sintoma foram testadas com o teste de Friedman. Comparações entre sintomas psiquiátricos (ansiedade, delírio, distúrbio do sono) e sintomas não psiquiátricos foram analisadas pelo teste U de Mann–Whitney. As comparações entre os dois modelos (ChatGPT-4o e ChatGPT-5) foram realizadas por meio de teste de classificação assinada de Wilcoxon. A. A p. p-valor <0,05 foi considerado estatisticamente significativo.

Considerações éticas

Como não foram utilizados dados reais dos pacientes, não foi necessária a aprovação do comitê de ética.

Resultados

Foram avaliados 10 cenários de sintomas de cuidados paliativos com ChatGPT-4o e, 1 semana depois, com ChatGPT-5. Cada cenário foi apresentado no mesmo formato e concluído com prompts abertos idênticos. As respostas foram avaliadas em quatro domínios: adequação clínica, segurança, sensibilidade ética e compreensibilidade. É importante ressaltar que nenhuma das respostas continha informações enganosas ou prejudiciais.

Acordo inter-classificatório

A fiabilidade inter-rater foi consistentemente elevada em todos os domínios para ambos os modelos. Para ChatGPT-4o, os valores kappa de Cohen ponderados foram 0,871 para adequação clínica, 0,820 para segurança, 0,833 para sensibilidade ética e 0,806 para compreensibilidade, com os valores correspondentes de rho de Spearman de 0,876, 0,825, 0,832 e 0,813 (todos p. p < 0,001). O ChatGPT-5 apresentou concordância similarmente alta, com valores kappa de 0,886, 0,844, 0,859 e 0,841, e valores rho de Spearman de 0,888, 0,849, 0,861 e 0,845 (todos p. p < 0,001). Estes resultados confirmam a fiabilidade e consistência das avaliações dos peritos. A concordância consistentemente alta entre avaliadores observada em todos os domínios avaliados suporta a robustez do processo de avaliação e indica que qualquer viés potencial introduzido por desvinculação parcial foi mínimo e não influenciou significativamente os resultados.

Avaliação específica-sintoma

Como mostra a Mesa 2o ChatGPT-5 consistentemente alcançou pontuações mais altas do que o ChatGPT-4o em quase todos os domínios. Adequação clínica: As maiores melhorias foram observadas nos cenários de ansiedade, úlcera por pressão, náusea, boca seca e perturbação do sono. Segurança: O GPT-5 apresentou ganhos notáveis em cenários de delírio, constipação e diarréia. Sensibilidade ética: Ambos os modelos tiveram uma pontuação alta, embora o GPT-5 tenha alcançado pontuações perfeitas (5,0) em dor, delírio, dispneia, constipação, diarréia, boca seca e distúrbio do sono. Compreensibilidade: A maior melhora foi verificada no cenário de perturbação do sono.

Mesa 2.O. Comparação dos escores médios de domínio para ChatGPT-4 e GPT-5 em cenários de sintomas de cuidados paliativos.

| Sintoma | Adequação clínica (GPT-4) | Adequação clínica (GPT-5) | Segurança (GPT-4) | Segurança (GPT-5) | Sensibilidade ética (GPT-4) | Sensibilidade ética (GPT-5) | Compreensibilidade (GPT-4) | Compreensibilidade (GPT-5) |

|---|---|---|---|---|---|---|---|---|

| Dor | 4.0 | 4.0 | 3.0 | 4.0 | 5.0 | 5.0 | 4.0 | 4.0 |

| Ansiedade | 3.0 | 4.0 | 2.5 | 3.5 | 4.0 | 4.0 | 3.0 | 4.0 |

| Úlcera pressão | 3.0 | 4.0 | 3.5 | 4.0 | 4.0 | 4.0 | 3.0 | 4.0 |

| Náusea | 3.0 | 4.0 | 3.0 | 4.0 | 4.0 | 4.5 | 3.0 | 4.0 |

| Delírio | 3.0 | 3.0 | 2.5 | 4.0 | 4.0 | 5.0 | 3.0 | 3.5 |

| Dispneia | 3.5 | 4.0 | 3.0 | 4.0 | 5.0 | 5.0 | 3.5 | 4.0 |

| Constipação | 3.0 | 3.5 | 3.0 | 4.5 | 5.0 | 5.0 | 3.0 | 4.0 |

| Diarréia | 3.5 | 4.0 | 3.5 | 5.0 | 5.0 | 5.0 | 4.0 | 4.0 |

| Monte seco | 3.0 | 4.0 | 3.0 | 4.0 | 5.0 | 5.0 | 3.0 | 4.5 |

| Distúrbio sonífero | 2.5 | 4.5 | 3.0 | 4.0 | 4.5 | 5.0 | 2.5 | 4.5 |

Análise descritiva das respostas de menor pontuação

Os escores mais baixos em ambos os modelos foram principalmente devidos a detalhes específicos de cenários insuficientes, articulação limitada de considerações risk–benefit, estruturação subótima de recomendações e integração incompleta de sensibilidade ética. Na adequação clínica, as omissões incluíram estratégias específicas da doença (por exemplo, bisfosfonatos ou denosumabe para dor óssea metastática, regimes antieméticos direcionados, protocolos padronizados para constipação induzida por opiáceos) ou estruturas diagnósticas incompletas (por exemplo, estadiamento em úlceras de pressão, trabalho etiológico sistemático em delirium). Na segurança, as lacunas comuns incluíram falta de parâmetros de monitoramento, especificação limitada de contra-indicações ou efeitos adversos (por exemplo, riscos de benzodiazepínicos em DPOC/demência, prolongamento de QT, interações medicamentosas–drug) e vias insuficientes de escalada/desescalação. Na sensibilidade ética, as deduções decorreram da atenção inadequada ao consentimento informado, discussão incompleta do equilíbrio risco–benefício, e incorporação limitada das preferências dos pacientes. Por exemplo, no cenário de ansiedade relacionada à DPOC, os riscos de benzodiazepínicos não foram claramente comunicados, os processos de consentimento estavam ausentes e o planejamento psiquiátrico de longo prazo não integrava suficientemente a escolha do paciente. No cenário de úlcera por pressão, o não estabelecimento de mecanismos de responsabilização pelo reposicionamento e a ênfase limitada nos direitos assistenciais dos pacientes reduziram os escores éticos. Na compreensibilidade, as reduções foram associadas à ausência de algoritmos stepwise, sequenciamento pouco claro do gerenciamento e planos de ação insuficientemente detalhados que poderiam dificultar a implementação clínica. No geral, embora ambos os modelos tenham fornecido recomendações contextualmente precisas e relevantes, o desempenho diminuiu quando faltou precisão, orientação estruturada, estruturas de segurança explícitas e integração ética abrangente.

Comparações de domínios dentro do sintoma

Os resultados do teste de Friedman mostraram que, no ChatGPT-4o, diferenças significativas de domínio foram observadas apenas para náuseas (χ2 (2) = 7,82, p. p = 0,049), sendo o maior escore em adequação clínica e o menor em compreensibilidade. No ChatGPT-5, foram observadas diferenças significativas na ansiedade (χ2 (2) = 11,20, p. p = 0,011) e náuseas (χ2 (2) = 8,23, p. p = 0,042). Para a ansiedade, a sensibilidade ética obteve maior escore e a segurança menor, enquanto para a náusea, a adequação clínica foi maior e a compreensibilidade menor.

Comparações de sintomas psiquiátricos versus não psiquiátricos

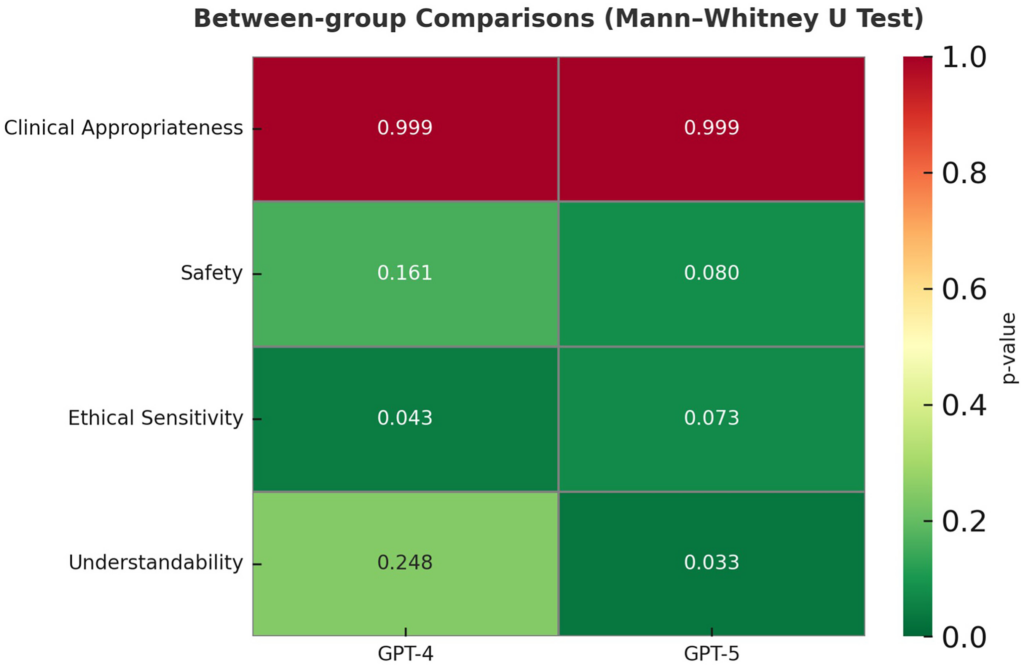

As comparações entre grupos revelaram que, no ChatGPT-4 o, a sensibilidade ética foi significativamente maior para os sintomas psiquiátricos (U. U = 3,0, p. p = 0,043), enquanto a adequação clínica (p. p = 0,999), segurança (p. p = 0,161), e compreensibilidade (p. p = 0,248) não apresentaram diferenças. No ChatGPT-5, a compreensibilidade foi significativamente maior para sintomas não-psiquiátricos (U. U = 2,0, p. p = 0,033). Diferenças na adequação clínica (p. p = 0,999) foram não significativos, enquanto que a segurança (p. p = 0,080) e sensibilidade ética (p. p = 0,073) aproximou-se da significância (Figura 1) (S).

Figura 1.O. Mapa de calor mostrando p. p-valores dos testes U de Mann–Whitney comparando grupos de sintomas psiquiátricos e não psiquiátricos em quatro domínios de avaliação para GPT-4 e GPT-5.

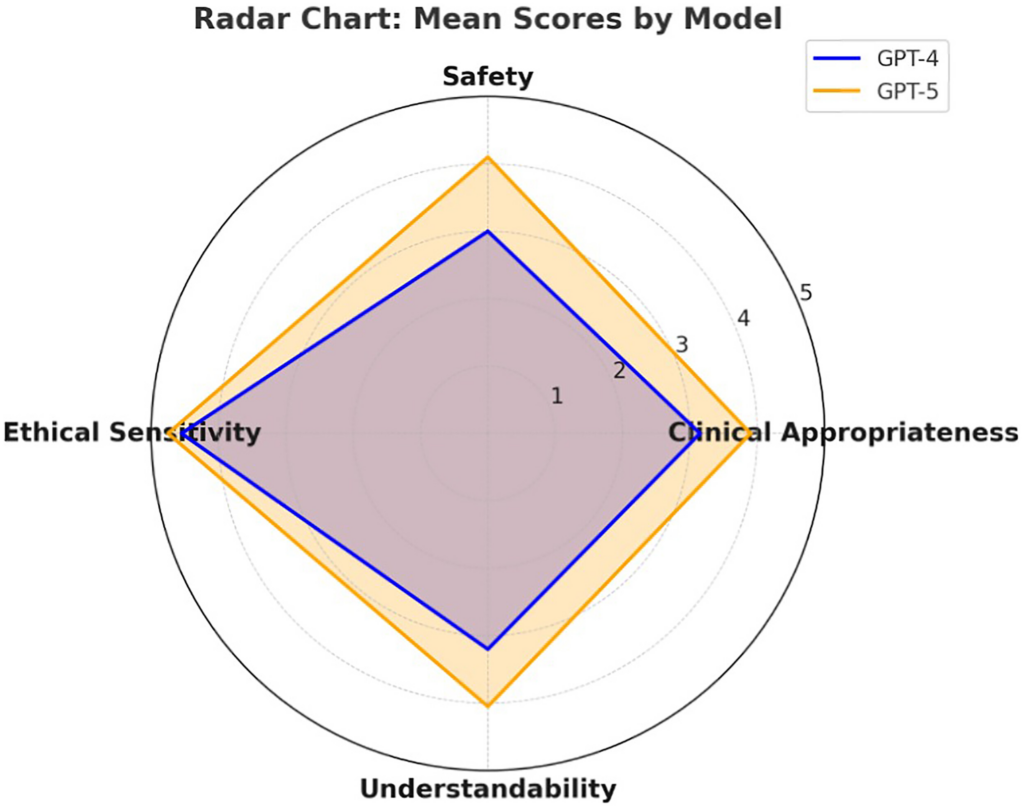

Os testes com classificação assinada da Wilcoxon demonstraram que o ChatGPT-5 teve um desempenho significativamente melhor do que o ChatGPT-4o na adequação clínica (p. p = 0,010), segurança (p. p = 0,002), e compreensibilidade (p. p = 0,011). A melhora da sensibilidade ética não foi estatisticamente significativa (p. p = 0,102) (Mesa 3) (S). Análises visuais apoiaram esses resultados, com gráficos de radar mostrando uma mudança ascendente consistente nos escores do GPT-5 em todos os domínios, principalmente em segurança e compreensibilidade (Figura 2) (S).

Figura 2.O. Gráfico de radar ilustrando as médias dos escores de ChatGPT-4o e ChatGPT-5 nos domínios da adequação clínica, segurança, sensibilidade ética e compreensibilidade.

Mesa 3.O. Comparação direta do ChatGPT-4 e ChatGPT-5 entre domínios de avaliação usando testes de classificação assinada Wilcoxon.

| Domínio | ChatGPT-4 (Médio, SD) | ChatGPT-5 (Médio, SD) | Kappa Inter-rater (GPT-4o e 5) | Tamanho do Efeito (r. r(S) | P. P-valor* |

|---|---|---|---|---|---|

| Adequação clínica | 3,15, 0,97 | 3,90, 0,71 | 0.871–0.886 | 0,81 | 0,010 |

| Segurança | 3,00, 0,94 | 4.10, 0.72 | 0.820–0.844 | 0,98 | 0,002 |

| Sensibilidade ética | 4,55, 0,65 | 4,75, 0,55 | 0.833–0.859 | 0,52 | 0,102 |

| Compreensibilidade | 3,20, 1,01 | 4,05, 0,78 | 0.806–0.841 | 0,81 | 0,011 |

*Testes de classificação assinada Wilcoxon.

Discussão

Neste estudo, 10 cenários de sintomas relacionados aos cuidados paliativos foram apresentados aos modelos ChatGPT. De acordo com avaliações de especialistas, o modelo ChatGPT-5, lançado em agosto de 2025, teve um desempenho melhor do que o modelo ChatGPT-4o no gerenciamento de sintomas de cuidados paliativos em termos de adequação clínica, segurança e compreensibilidade. No entanto, em ambos os modelos, certas respostas dos sintomas apresentaram limitações quanto à adequação clínica, segurança, sensibilidade ética e compreensibilidade.

A maioria dos estudos existentes que examinam o papel do ChatGPT nos cuidados paliativos foi realizada nos últimos 2 anos. Até onde sabemos, nenhuma pesquisa anterior corresponde de forma abrangente a este estudo em termos de escopo, design e rigor metodológico. Os resultados do estudo farão uma contribuição distinta e oportuna para a literatura. É importante ressaltar que, como o ChatGPT-5 foi lançado recentemente, essa investigação está entre as primeiras a avaliar seu desempenho no contexto dos cuidados paliativos. Além disso, a comparação direta e baseada em cenários entre o ChatGPT-5 e seu antecessor, o ChatGPT-4o, oferece uma perspectiva rara e valiosa sobre a evolução das capacidades de LLM, permitindo uma avaliação baseada em evidências dos avanços geracionais relevantes para o apoio à decisão clínica. No entanto, um estudo tematicamente semelhante foi conduzido por Braun et al. em 2023. No estudo publicado por Braun et al., a qualidade e a concordância diretriz do ChatGPT’foram avaliadas sugestões de tratamento para sintomas paliativos específicos da oncologia ginecológica.21 Neste estudo, as respostas do ChatGPT a 10 diferentes cenários de sintomas ginecológicos foram analisadas por especialistas médicos.21 Os resultados do estudo indicam que modelos de linguagem como o ChatGPT podem fornecer recomendações gerais de tratamento para sintomas do paciente que são em grande parte consistentes com as diretrizes clínicas.21 No entanto, observou-se que o ChatGPT ocasionalmente omitia opções importantes de tratamento e não conseguia fornecer um plano de tratamento personalizado.21 Assim como os achados de Braun et al., este estudo também revelou que as respostas de tratamento do ChatGPT foram insuficientes para certos sintomas. Braun et al. enfatizaram em seu estudo que as recomendações de tratamento devem sempre ser apoiadas pela contribuição do médico especialista para serem completas e individualizadas.21

Embora não tenha sido conduzido diretamente em um grupo de pacientes paliativos, o estudo de Bianco et al. enfocou pacientes com dor crônica em tratamento opióide de longo prazo, uma população indiretamente relacionada à prática de cuidados paliativos. Perguntas frequentes feitas por esses pacientes foram submetidas ao ChatGPT.22 . Foram avaliadas a fiabilidade, precisão e compreensibilidade das respostas do ChatGPT.22 . No geral, as respostas do ChatGPT mostraram alta confiabilidade e boa compreensibilidade. Da mesma forma, neste estudo, o ChatGPT demonstrou boa compreensibilidade no manejo dos sintomas de dor. Bianco et al. também mostraram que os sistemas de IA têm um potencial significativo como ferramentas complementares na educação do paciente.22 . No entanto, enfatizou-se que o desempenho pode ser limitado em questões que exigem alto conhecimento técnico ou ser influenciado pelo contexto clínico. Portanto, a integração de aplicações de IA na prática clínica deve envolver a colaboração com profissionais de saúde para garantir precisão, personalização e respostas atualizadas.22 .

No estudo conduzido por Jimenez et al. em 2024, os pesquisadores investigaram a qualidade de resposta da ferramenta de IA ChatGPT em vários domínios da medicina geriátrica e o grau de concordância entre suas respostas e avaliações doctors’.23 Projetada de forma semelhante a este estudo, a pesquisa envolveu apresentar o ChatGPT com 10 cenários clínicos relacionados à geriatria e solicitar aos médicos que avaliassem as respostas geradas pela IA usando uma escala Likert de 5 pontos.23 Dentre esses cenários, dois estavam diretamente relacionados ao delírio. O ChatGPT recebeu escores médios de 2,9/5 e 3,0/5 para esses cenários, respectivamente, fazendo com que eles estivessem entre os casos de menor audiência do estudo.23 Esses achados são consistentes com os resultados deste estudo, no qual as respostas do ChatGPT às questões relacionadas aos sintomas delirium também receberam escores mais baixos em comparação com outras categorias de sintomas. Essas baixas classificações destacam as limitações da IA no manejo de condições multifacetadas como o delirium, que muitas vezes exigem avaliação clínica rápida e intuição médica. Apesar de seu desempenho mais forte em questões de conhecimento teórico ou geral, esses achados sugerem que o ChatGPT ainda não é suficientemente confiável para apoiar a tomada de decisões clínicas em cenários complexos, como delirium, particularmente em ambientes de cuidados geriátricos e paliativos.

Embora este estudo se concentre no manejo de sintomas, que continua sendo uma área relativamente pouco explorada no contexto dos cuidados paliativos e do ChatGPT, vários estudos na literatura existente examinaram o uso do ChatGPT em outros aspectos dos cuidados paliativos. Em um estudo observacional e transversal realizado por Hanci et al. em 2024, a qualidade, a confiabilidade e a legibilidade das informações fornecidas pelo ChatGPT e outros chatbots sobre cuidados paliativos foram comparativamente avaliadas.14 Hanci et al. relataram que, em geral, os níveis de legibilidade e a qualidade do conteúdo dos textos foram considerados inadequados para fins de educação do paciente.14 Desta forma, destaca-se que os sistemas de IA utilizados em áreas sensíveis, como os cuidados paliativos, devem ser aprimorados para fornecer informações mais compreensíveis e de alta qualidade.14 Em contraste com a abordagem de Hanci et al., nosso estudo se concentrou nas respostas do ChatGPT aos sintomas comumente encontrados no cenário de cuidados paliativos, em vez de perguntas gerais geradas pelo paciente.

Em 2024, Kim et al. avaliaram a capacidade dos chatbots de definir e distinguir os termos cuidados paliativos, cuidados de suporte e cuidados paliativos.16 Kim et al. mostraram que, embora as plataformas de IA geralmente tenham alta precisão, elas ainda têm limitações significativas em termos de confiabilidade e abrangência.16 Em 2025, Admane et al. pediram aos modelos de IA que definissem os termos “doente terminal,” “fim da vida,” “transições de atendimento,” e “morrendo ativamente.”24 O estudo mostrou que, embora os chatbots pudessem definir alguns termos com alta precisão, eles tinham deficiências significativas em confiabilidade e legibilidade. Portanto, essas tecnologias devem ser avaliadas sob supervisão clínica antes de serem usadas como fontes de informação direta em cuidados paliativos.24

Em seu estudo de 2023, Srivastava et al. examinaram o papel das tecnologias de IA na comunicação, particularmente no final da vida.25 Avaliaram se o ChatGPT poderia contribuir para os processos de comunicação em cuidados paliativos. Sugeriram que o ChatGPT poderia ser considerado uma ferramenta complementar na comunicação terapêutica.25 No entanto, essas tecnologias ainda não podem substituir totalmente a interação humana; qualidades específicas do ser humano, como empatia, intuição e consciência contextual, permanecem além do escopo da IA.25 Em seu estudo de 2024, Burry et al. afirmaram que o uso da IA como ferramenta de comunicação direta em campos altamente sensíveis, como cuidados paliativos, não é apropriado. No entanto, eles sugeriram que poderia servir como uma valiosa ferramenta de apoio para treinar médicos em linguagem e abordagem para comunicação de doenças graves.26

Uma das principais limitações metodológicas do presente estudo é a sua dependência de insumos padronizados e baseados em cenários, em vez de encontros clínicos em tempo real. Embora isso limite a validade externa e possa não capturar totalmente a complexidade e variabilidade do atendimento ao paciente no mundo real, a abordagem foi deliberadamente escolhida para abordar várias considerações importantes. Primeiro, os testes baseados em cenários permitem uma avaliação eticamente segura e controlada das recomendações geradas pela IA sem expor dados identificáveis do paciente. Isso é particularmente relevante nos cuidados paliativos, onde a vulnerabilidade do paciente e as preocupações com a privacidade são primordiais. Em segundo lugar, ao padronizar os insumos clínicos, esse design reduz a variabilidade descontrolada, permitindo uma comparação justa e consistente entre vários tipos de sintomas e domínios de avaliação. Além dessas considerações metodológicas, o estudo apresenta outras limitações. Primeiro, os cenários foram preparados apenas em turco. Estudos futuros que incorporem cenários multilíngues e painéis de avaliadores transculturais são necessários para avaliar a generalização. Considerando que o desempenho dos LLMs pode variar de acordo com o idioma, nossas descobertas refletem principalmente a experiência do usuário turco, o que pode limitar a generalização dos resultados para outros idiomas. Em segundo lugar, embora as avaliações médicas envolvam um alto nível de especialização, elas podem inerentemente incluir julgamentos subjetivos. Em particular, o domínio da sensibilidade ética envolve inerentemente o julgamento interpretativo, pois o raciocínio ético em cuidados paliativos é dependente do contexto e carregado de valor. Outra limitação é que as respostas foram avaliadas por apenas dois médicos da mesma unidade de cuidados paliativos. Embora a concordância entre avaliadores tenha sido excelente, a falta de um painel de classificação mais diversificado pode limitar a generalização das descobertas.

Apesar dessas limitações, o estudo também tem vários pontos fortes notáveis. Pelo que sabemos, é um dos primeiros a avaliar o ChatGPT-5 no contexto dos cuidados paliativos e a comparar diretamente seu desempenho com o ChatGPT-4, oferecendo informações valiosas sobre melhorias geracionais em LLMs. O uso de avaliadores especialistas com experiência especializada em cuidados paliativos garantiu avaliações de alta qualidade e clinicamente relevantes. Além disso, o desenho de cenário estruturado e específico de sintomas permitiu uma avaliação focada em vários domínios críticos adequação clínica, segurança, sensibilidade ética e compreensibilidade, proporcionando uma visão abrangente do potencial e limitações do modelo no suporte à decisão clínica.

O lançamento de uma nova versão de um modelo de IA não significa automaticamente que seu suporte à decisão clínica será melhor. Essa suposição é especialmente pouco confiável em áreas como cuidados paliativos, onde a segurança e os princípios éticos são criticamente importantes. Assim, cada novo modelo deve ser reavaliado sistematicamente dentro do domínio relevante para determinar se oferece melhoria genuína ou se há regressões na segurança ou no desempenho ético.20‚,27 Os achados deste estudo trazem implicações importantes tanto para a prática clínica quanto para futuras pesquisas em cuidados paliativos. As melhorias mensuráveis observadas com o ChatGPT-5 destacam seu potencial como ferramenta suplementar de apoio à decisão, particularmente em ambientes limitados por recursos, onde o acesso oportuno a conhecimentos multidisciplinares é frequentemente restrito. No entanto, as recomendações geradas por IA devem ser consideradas complementares e não substitutivas, garantindo que o julgamento clínico, a supervisão ética e o atendimento individualizado permaneçam centrais para a tomada de decisões. Essa perspectiva se alinha ao discurso mais amplo da literatura, que enfatiza que a IA é projetada para aumentar em vez de substituir os provedores de assistência médica.28

Pesquisas futuras devem incluir estudos de validação multilíngues, avaliações potenciais do mundo real em diversas populações de pacientes e investigações sobre a integração segura de ferramentas de IA em fluxos de trabalho clínicos e sistemas eletrônicos de registros de saúde. Além disso, estudos comparativos que avaliam o desempenho do modelo em relação aos médicos em início de carreira podem ajudar a esclarecer a utilidade prática e o potencial valor educacional da IA generativa em cuidados paliativos. Além disso, pesquisas comparando diretamente os resultados generativos da IA com as fontes de informação tradicionalmente usadas por pacientes e cuidadores familiares podem oferecer insights valiosos sobre a relevância, acessibilidade e limitações do mundo real dessas ferramentas. Tais esforços serão essenciais para determinar a viabilidade, segurança, impacto clínico a longo prazo e para orientar a adoção responsável da IA generativa na prática clínica.

Conclusões

Este estudo é, tanto quanto sabemos, um dos primeiros a avaliar o ChatGPT-5 em cuidados paliativos e a compará-lo diretamente com o ChatGPT-4o em vários domínios clinicamente importantes. Com base em 10 cenários padronizados de sintomas avaliados por médicos experientes, o ChatGPT-5 mostrou melhorias significativas na adequação, segurança e compreensibilidade clínicas, enquanto a sensibilidade ética permaneceu alta em ambos os modelos sem uma diferença significativa.

O forte acordo entre os avaliadores sustenta a credibilidade desses resultados. No geral, os achados sugerem que os LLMs, particularmente o ChatGPT-5, podem servir como ferramentas complementares úteis para a tomada de decisões clínicas no manejo paliativo de sintomas. Ao mesmo tempo, o estudo sublinha a necessidade de maior refinamento para melhorar a precisão, garantir mecanismos de segurança robustos e fortalecer a integração de princípios éticos centrados no paciente. O trabalho futuro deve ter como objetivo validar o desempenho em ambientes clínicos do mundo real, em diferentes idiomas e nos fluxos de trabalho de assistência médica existentes. Em última análise, em um campo sensível, como os cuidados paliativos, a IA generativa deve ser usada apenas como um auxílio de apoio, com a responsabilidade final e as decisões permanecendo nas mãos dos clínicos.

Fonte: https://journals.sagepub.com/doi/10.1177/20552076261419956